今天我们为大家深入解析的是澳门科技大学(MUST)创新工程学院计算机科学与工程学院的谢璇(Xuan Xie)博士。谢博士是一位专注于大语言模型可信性分析、AI系统安全与神经网络验证的青年学者,研究方向紧扣当前AI安全领域最前沿的议题。接下来,我们将从院系背景、导师履历、研究领域到代表性论文,为大家全方位拆解这位导师的学术画像。

📘 院系概况

澳门科技大学创新工程学院(Faculty of Innovation Engineering, FIE)成立于2022年,下设计算机科学与工程学院、工程科学系、材料科学与工程系及环境科学与工程系四大学术单元。其中,计算机科学与工程学院(SCSE)是FIE的核心组成部分,拥有超过60位全职教研人员,覆盖人工智能、软件工程、网络安全、数据科学等多个前沿方向。澳科大近年在QS世界排名中持续攀升(2026年排名第440位),SCSE的科研实力也在快速增长。

🔬 导师简介

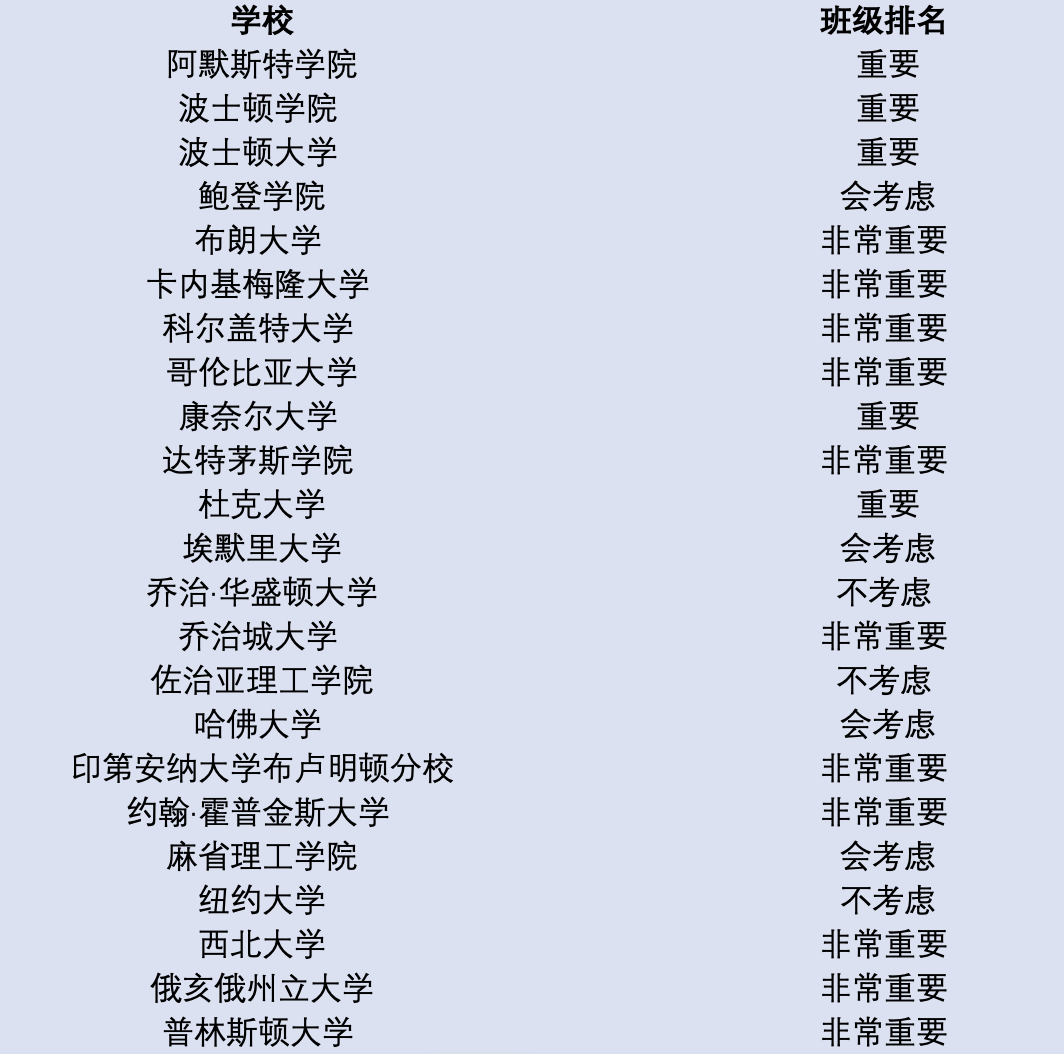

谢璇(Xuan Xie),现任澳门科技大学创新工程学院计算机科学与工程学院助理教授(Assistant Professor)。谢博士于加拿大阿尔伯塔大学(University of Alberta)获得计算机科学博士学位,师从软件工程与AI测试领域知名学者马磊(Lei Ma)教授;硕士毕业于德国马克斯·普朗克软件系统研究所(MPI-SWS);本科毕业于中山大学。

根据Google Scholar数据,谢博士已累计被引用156次,发表论文涵盖CCF-A类顶级会议与期刊(如ICSE、AAAI、IJCAI、IEEE TSE等),学术影响力持续上升。谢博士同时担任IEEE TSE、IEEE TR、EMSE等顶级期刊的审稿人,以及ICLR、NeurIPS、ICML、ACL等顶会PC成员。

大语言模型可信性AI安全神经网络验证信息物理系统软件工程

🔍 研究领域深入解析

谢博士的研究围绕"如何让AI系统更安全、更可信"这一核心命题展开,涵盖大语言模型、信息物理系统和神经网络三大场景,形成了从理论验证到工程实践的完整研究链条。以下我们逐一拆解其主要研究方向:

❶ 大语言模型可信性分析(Trustworthy LLM)

这是谢博士当前最核心的研究方向。随着ChatGPT等大语言模型的广泛应用,其鲁棒性、幻觉问题、公平性及安全性成为学术界与工业界共同关注的焦点。谢博士的工作主要从模型内部状态出发,构建基于抽象模型的LLM行为分析框架(如LUNA框架),能够对LLM的隐藏层状态进行建模,并从多个质量维度(如鲁棒性、一致性、幻觉检测)进行系统性分析。此外,他还在探索LLM的在线安全检测机制,以及如何唤醒LLM内在的安全意识以防御越狱攻击。

❷ AI驱动信息物理系统安全(AI-CPS Safety)

信息物理系统(CPS)是指将计算、通信与物理过程深度融合的系统,典型应用如自动驾驶汽车和工业机器人。当这些系统引入深度学习组件后,传统的安全分析方法面临严峻挑战。谢博士提出了语义引导的安全增强框架SIEGE,通过将信号时序逻辑(Signal Temporal Logic)与深度强化学习结合,实现对AI-CPS系统的安全性约束与增强。此外,他还基于NVIDIA Isaac Sim仿真平台构建了工业级AI-CPS基准测试集,为机器人操控场景的安全评估提供了标准化工具。

❸ 神经网络形式化验证(Neural Network Verification)

传统的神经网络验证工具只能处理输入输出层面的一阶约束(如对抗鲁棒性),对于更复杂的现实世界属性(如"自动驾驶车辆必须在停止标志前停车")则无能为力。谢博士提出了神经符号验证(Neuro-Symbolic Verification)框架,创造性地将神经网络本身作为逻辑规约的一部分,从而使验证工具能够处理远超传统范畴的复杂属性。他还在公平性验证方面提出了DeepGemini方法,能够对深度神经网络的依赖公平性进行形式化验证。

❹ LLM测试覆盖率准则(LLM Testing)

在软件工程视角下,如何定义和衡量LLM的测试充分性是一个全新的挑战。谢博士提出了多层级测试覆盖率准则LeCov,从LLM的注意力机制、前馈层、嵌入层等多个内部层次定义覆盖指标,填补了传统深度学习测试覆盖标准在LLM场景下的空白,为LLM的系统性质量评估提供了可操作的方法论。

从整体来看,谢博士的四个方向之间存在清晰的逻辑联系:神经网络验证提供理论基础,AI-CPS安全关注物理世界的工程应用,LLM可信性分析聚焦最前沿的大模型,而LLM测试则从软件质量保障角度串联全局。这种从底层理论到上层应用的系统布局,使得课题组能够在AI安全这个大方向上形成闭环。

📄 精读教授所发表的文章

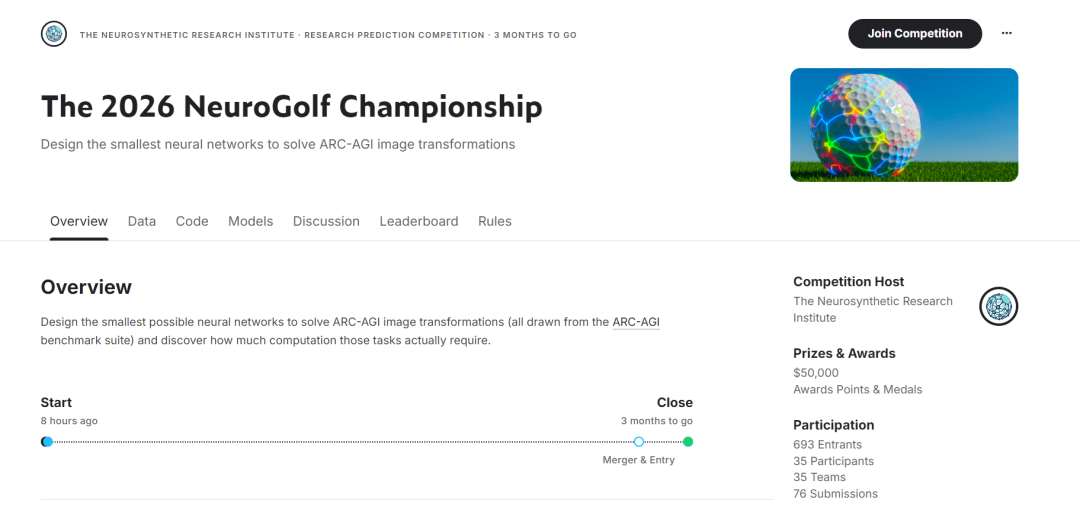

LUNA: A Model-Based Universal Analysis Framework for Large Language Models

Da Song*, Xuan Xie* 等 | IEEE Transactions on Software Engineering (TSE), 2024, Vol.50, No.7, pp.1921-1948 | CCF-A

该论文针对LLM在鲁棒性、幻觉等方面的可信性问题,提出了名为LUNA的通用分析框架。LUNA的核心思想是对LLM的隐藏层激活状态进行抽象建模,学习状态转移函数,从而在不依赖外部标注的情况下,从内部视角对LLM行为进行多维度质量分析。该框架具有良好的通用性和可扩展性,被ICSE 2025选为Journal-first论文。这项工作在LLM内部状态分析这一新兴领域具有开创性意义,为后续的幻觉检测、对齐评估等研究奠定了方法论基础。

DeepGemini: Verifying Dependency Fairness for Deep Neural Network

Xuan Xie, Fuyuan Zhang, Xinwen Hu, Lei Ma | AAAI 2023 | CCF-A

该论文提出了DeepGemini方法,用于对深度神经网络的"依赖公平性"进行形式化验证。传统公平性验证主要关注个体公平性和群体公平性,而依赖公平性关注的是模型决策是否在不同敏感属性条件下保持逻辑一致。DeepGemini利用模块化验证策略,将大规模网络拆分为可独立验证的子模块,显著提升了验证效率。这项工作发表在AI领域顶级会议AAAI上,为AI公平性的形式化保障提供了新的技术路径。

Neuro-Symbolic Verification of Deep Neural Networks

Xuan Xie, Kristian Kersting, Daniel Neider | IJCAI 2022 | CCF-A

该论文引入了"神经符号验证"的全新范式,将神经网络本身作为逻辑规约的组成部分,从而突破了传统验证工具只能处理一阶约束的局限。例如,对于"自动驾驶车辆必须识别停止标志并停车"这类涉及语义理解的复杂属性,传统方法难以表达和验证,而该框架能够自然地对其进行形式化建模。这项发表在IJCAI上的工作,为深度神经网络验证领域拓展了全新维度。

SIEGE: A Semantics-Guided Safety Enhancement Framework for AI-enabled Cyber-Physical Systems

Jiayang Song, Xuan Xie, Lei Ma | IEEE Transactions on Software Engineering (TSE), 2023 | CCF-A

该论文聚焦AI驱动的信息物理系统安全增强问题。SIEGE框架通过将信号时序逻辑(STL)规约转化为可微分的奖励信号,与深度强化学习的训练过程深度集成,在不牺牲任务性能的前提下提升系统的安全行为。该方法在自动驾驶、机器人操控等多个AI-CPS场景中验证了有效性。这篇CCF-A期刊论文体现了谢博士在将形式化方法与深度学习工程实践相结合方面的深厚功力。

💡 GEO博士有话说

基于谢博士的研究脉络和近期论文,我们的博士团队为有意向套磁的同学提出以下三个具有创新性和可行性的研究构想:

构想一:面向多模态大模型的可信性分析框架扩展

谢博士的LUNA框架目前主要面向文本LLM,而多模态大模型(如GPT-4V、Gemini)在图像-文本交互过程中的可信性问题尚缺少系统性分析工具。可以尝试将LUNA的抽象建模方法扩展至视觉编码器与语言解码器的交界处,分析多模态融合过程中的幻觉产生机制,这与谢博士现有的LLM可信性研究高度衔接。

构想二:基于LLM Agent的CPS安全自动化测试

谢博士在AI-CPS安全和LLM分析两个方向上均有深厚积累。一个有趣的交叉点是:能否利用LLM作为智能代理(Agent),自动生成针对CPS系统的对抗性测试场景?例如,让LLM理解CPS的安全规约后,自主生成可能触发违规行为的边界工况。这种"以AI测AI"的思路,可以将两个方向的优势有机融合。

构想三:大语言模型的增量式形式化验证

谢博士在神经网络验证方面有出色的理论背景。当前LLM经过微调或RLHF后,其安全属性可能发生变化,但对整个模型重新进行完整验证的计算开销极大。一个前沿方向是探索增量式验证方法——仅对模型更新部分进行局部验证,同时保证全局安全属性不被破坏。这一方向兼具理论深度和工程价值。