本期为大家深入解析新加坡国立大学(NUS)计算机科学系的Kenji Kawaguchi教授。Kawaguchi教授是深度学习理论领域的杰出青年学者,曾获NeurIPS 2024最佳论文奖,其研究横跨深度学习理论、大语言模型(LLM)安全与对齐、AI for Science等多个前沿方向。本文将从研究领域拆解、近期顶会论文精读到创新研究想法,为大家全方位解读这位实力与潜力兼备的导师。

📘 院系概况

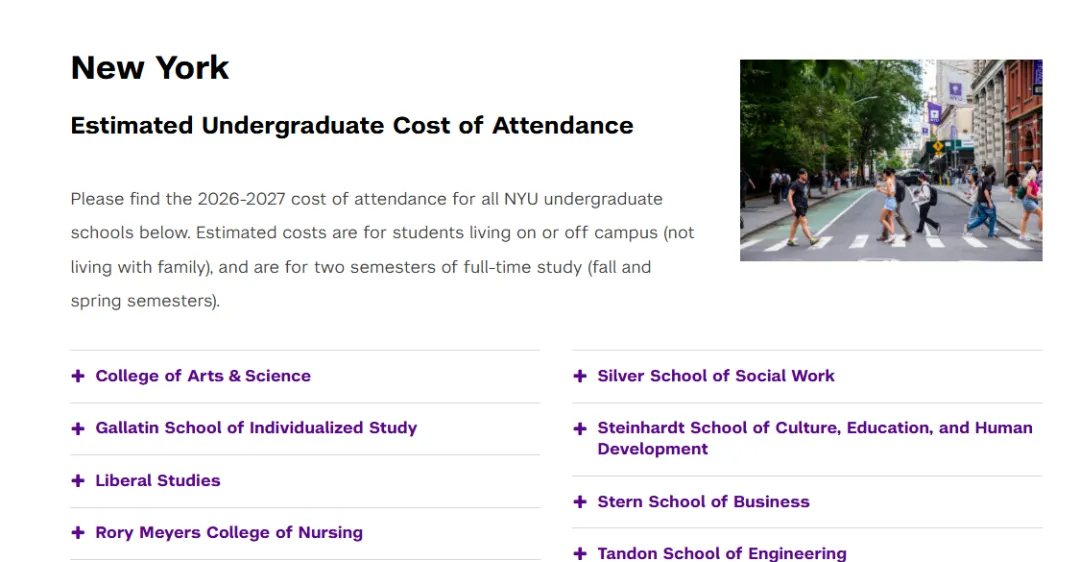

NUS School of Computing(计算机学院)是亚洲顶尖的计算机科学教育与研究机构,在2025年QS学科排名中位列全球第4、亚洲第1。学院下设计算机科学系和信息系统与分析系,拥有超过百位全职教研人员,研究覆盖人工智能、系统架构、数据库、安全、理论计算等核心方向,科研实力雄厚,与Google、Meta等顶级企业保持深度合作。

🎓 导师简介

Kenji Kawaguchi,现任NUS计算机科学系Presidential Young Professor(校长青年教授,终身教职序列)。他于麻省理工学院(MIT)获得计算机科学博士学位(导师为著名AI学者Leslie Pack Kaelbling,论文委员会成员包括Yoshua Bengio),随后在哈佛大学数学科学与应用中心从事博士后研究。

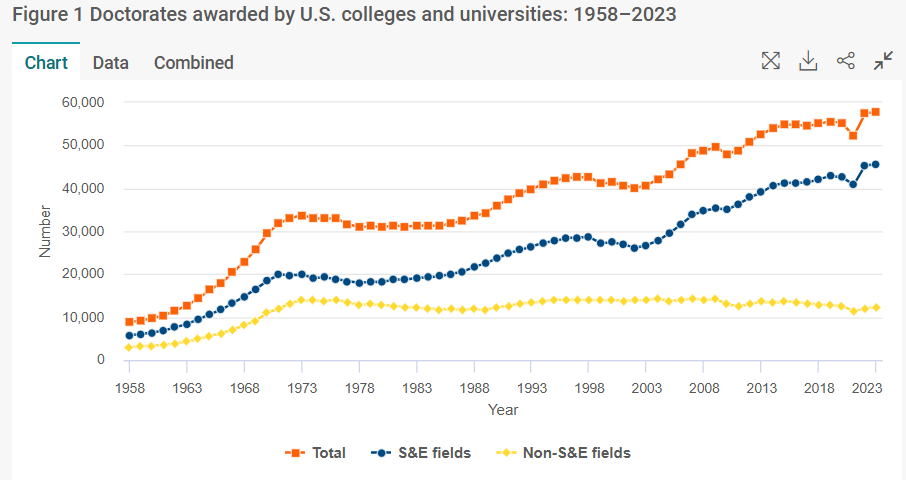

根据Google Scholar数据,Kawaguchi教授目前总引用数超过11,900次,发表论文170余篇,研究成果频繁刊登于NeurIPS、ICML、ICLR、CVPR、AAAI等AI领域顶级会议。2024年,其指导论文荣获NeurIPS 2024最佳论文奖。

深度学习理论大语言模型AI for Science优化理论生成模型

🔬 研究领域深度解析

Kawaguchi教授的研究体系以深度学习的理论基础为核心,同时向多个应用前沿延伸。以下我们将其研究方向拆解为五个子领域进行逐一解读:

❶ 深度学习优化与泛化理论这是Kawaguchi教授的学术根基。他的代表性工作"Deep Learning without Poor Local Minima"(NeurIPS 2016 Oral,引用近900次)从理论上证明了深度线性网络不存在差的局部最优解,为理解深度学习的训练动态提供了重要理论支撑。后续工作进一步拓展到非线性网络的全局收敛保证、泛化界等核心问题,与Yoshua Bengio、Tomaso Poggio等学者的合作使其理论框架具有广泛影响力。

❷ 大语言模型(LLM)安全与对齐近年来,Kawaguchi教授将理论功底应用于LLM的前沿研究。其团队在LLM安全性方面开展了多项重要工作,包括通过安全特定神经元理解和增强LLM的安全机制(ICLR 2025)、利用多样化攻击进行鲁棒红队测试(ICLR 2025),以及发现单字符扰动即可突破LLM对齐的脆弱性(AAAI 2025)。这些工作对构建可信AI系统具有重要意义。

❸ LLM推理与提示优化在提升LLM推理能力方面,Kawaguchi教授团队提出了基于自评估的逐步推理引导方法(NeurIPS 2023)和蒙特卡洛树搜索增强推理框架。他们还系统研究了LLM的多语言处理能力(NeurIPS 2024)和提示格式偏差问题(NAACL 2025),为理解和改进LLM的实际应用提供了重要洞见。

❹ AI for Science:物理信息神经网络与科学计算Kawaguchi教授与Brown大学George Em Karniadakis教授长期合作,在物理信息神经网络(PINNs)领域产出丰富。研究涵盖高维偏微分方程的求解、PINNs的泛化理论分析、状态空间模型用于时空PDE算子学习(DeepOMamba),以及密度泛函理论的深度学习方法(ICLR 2023)。这些工作将深度学习理论优势应用于物理模拟和科学发现。

❺ 生成模型与版权保护在生成式AI方面,Kawaguchi教授团队关注扩散模型的安全性和版权问题。他们发现更强的扩散模型更容易被植入后门(ICML 2024 Oral),并提出了针对文本到图像模型概率版权保护机制的攻击方法VA3(CVPR 2024 Highlight)。此外,团队还在概念擦除、扩散模型采样加速(Skip-Tuning)等方面做出贡献,兼顾理论深度与实际应用。

总体来看,Kawaguchi教授的研究路线呈现出"以理论为锚、向应用辐射"的清晰脉络:深度学习理论是底层基础,LLM和生成模型是当下热点方向,AI for Science则是长期布局的增长点。

📄 精读教授近期代表论文

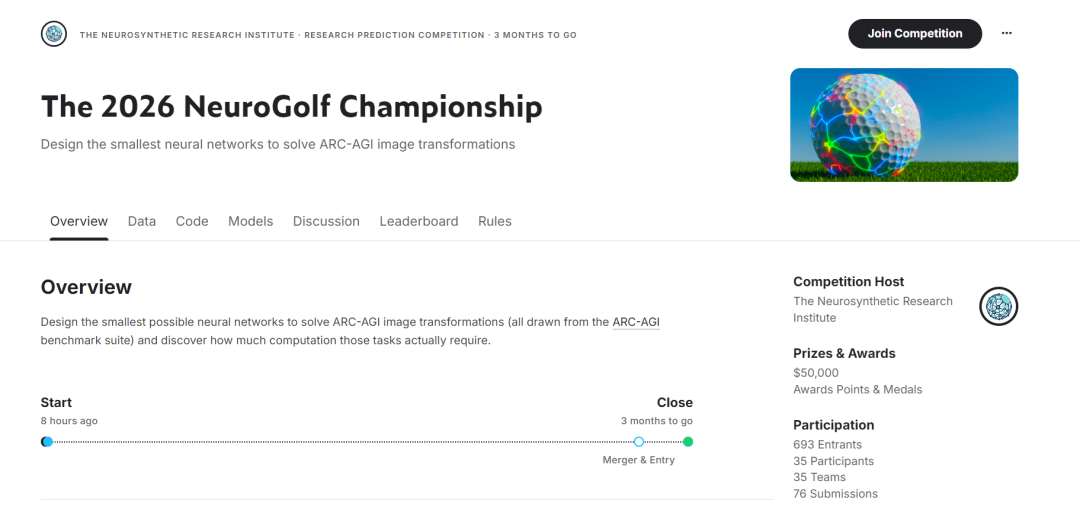

Stochastic Taylor Derivative Estimator: Efficient Amortization for Arbitrary Differential Operators

Zekun Shi, Zheyuan Hu, Min Lin, Kenji Kawaguchi · NeurIPS 2024 ·🏆 Best Paper Award

该论文提出了一种基于随机泰勒展开的微分算子估计方法,可以高效地对任意微分算子进行摊销计算。传统方法在计算高阶或高维微分时需要昂贵的自动微分开销,而本文方法通过随机化策略大幅降低了计算成本,同时保持了理论无偏性。该工作在物理信息神经网络等应用中展现了显著的效率提升。

学术贡献:为科学计算中的微分算子求解提供了全新的高效范式,是理论与计算完美结合的典范之作。

The Stronger the Diffusion Model, the Easier the Backdoor: Data Poisoning to Induce Copyright Breaches Without Adjusting Finetuning Pipeline

Haonan Wang, Qianli Shen, Yao Tong, Yang Zhang, Kenji Kawaguchi · ICML 2024 ·Oral Presentation

该研究揭示了扩散模型中一个反直觉的安全漏洞:模型能力越强,越容易通过数据投毒被植入后门以诱发版权侵权。作者提出了一种无需修改微调流程即可实施的后门攻击方法,展示了在标准训练范式下生成式AI的潜在风险。

学术贡献:首次系统性揭示了扩散模型能力与安全性之间的悖论关系,对AI安全与版权保护具有重要警示意义。

Understanding and Enhancing Safety Mechanisms of LLMs via Safety-Specific Neuron

Yiran Zhao, Wenxuan Zhang, Kenji Kawaguchi, Lidong Bing · ICLR 2025

本文从神经元层面深入剖析了大语言模型的安全机制,识别出负责安全行为的特定神经元,并基于此提出了增强LLM安全性的方法。研究发现,安全相关的神经元在模型中形成了可识别的子网络结构,通过有针对性的干预可以有效提升模型对有害输入的抵抗能力。

学术贡献:为LLM安全性研究提供了可解释性视角,开辟了通过神经元级操控实现精细安全控制的新路径。

Memory-Efficient Gradient Unrolling for Large-Scale Bi-level Optimization

Qianli Shen, Yezhen Wang, Zhouhao Yang, Xiang Li, Haonan Wang, Yang Zhang, Jonathan Scarlett, Zhanxing Zhu, Kenji Kawaguchi · NeurIPS 2024

双层优化在超参数搜索、元学习、模型蒸馏等场景中广泛应用,但梯度展开的内存开销限制了其在大规模问题中的使用。该论文提出了一种内存高效的梯度展开方法,在保证优化精度的同时大幅降低内存占用,使得双层优化能够扩展到LLM规模的训练任务中。

学术贡献:解决了大规模双层优化的核心瓶颈问题,为LLM时代的优化方法研究提供了实用工具。

💡 有话说

结合Kawaguchi教授的研究脉络和近期论文动态,我们为有意申请的同学提出以下三个具有创新性的研究方向建议:

想法一:基于安全神经元的LLM对齐自适应框架Kawaguchi教授团队已在ICLR 2025中识别了LLM的安全特定神经元。在此基础上,可以探索一种动态调节安全神经元激活强度的自适应对齐方案,根据输入上下文的风险等级自动调整安全约束的力度,实现"刚柔并济"的安全控制。这个方向兼顾了可解释性与实用性,与导师现有工作直接衔接。

想法二:物理信息引导的LLM科学推理增强教授在PINNs和LLM推理两个方向均有深厚积累,可以尝试将物理先验知识以结构化方式注入LLM的推理过程中,使模型在处理科学问题时不仅依赖语言模式匹配,还能遵循物理定律进行逻辑推导。这个交叉方向可以借鉴教授在D4FT(密度泛函理论深度学习)等工作中的经验。

想法三:泛化理论指导下的高效LLM蒸馏与剪枝Kawaguchi教授在泛化理论方面有深厚功底(如Mixup的鲁棒性分析、OOD泛化界等)。可以将这些理论工具应用于LLM压缩场景,设计具有理论保证的模型剪枝策略,在保持模型能力的同时实现高效部署。团队近期在ACL 2025发表的LLM剪枝工作为这个方向提供了良好起点。