过去一年,很多学生都有一种隐约的不安。

AI 没有像传言里那样一夜之间“毁掉一切工作”,但它确实在悄悄改变一些更底层的东西:

它改变了人们是如何完成任务的,也开始动摇一个更核心的问题——如果知识本身可以被即时生成,那学生到底还要学什么?

这个问题,最先被逼着回答的,并不是学生,而是大学。

最早的时候,美国高校的反应几乎是本能式的防御。禁止 AI、严查 AI、把“是否使用 AI”当作学术诚信问题处理。

但短短一两年后,风向彻底转了。

不是因为高校突然“想通了”,而是因为他们意识到:如果大学继续假装 AI 不存在,学生毕业后将直接暴露在一个他们完全没被训练过的世界里。

于是你开始看到一些看起来“很激进”的举动。

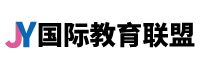

当普渡大学说:

不会用AI,你毕不了业。

普渡大学董事会通过了一项在美国高等教育圈引发强烈讨论的决定:从 2026 级新生开始,所有本科生必须展示“AI working competency”,否则无法毕业。

这并不是开一门“AI 入门课”那么简单。

普渡并没有规定学生必须学 Python、训练模型或写算法,而是把 AI 能力拆解成一种跨学科的“工作素养”,并明确要求它必须被嵌入每一个专业。

工程学院、农业学院、商学院、文科专业,要求都不一样,但有一个共同点:学生必须在与自己专业高度相关的项目中,证明自己知道:

- AI 能帮什么,不能帮什么

- 在真实决策中,什么时候该用 AI,什么时候不该

- AI 的结果应该如何被验证、修正、质疑

校方甚至明确表示,这个要求不增加额外学分,而是直接重塑既有课程结构。

换句话说,普渡并不是在“教你用 AI”,而是在告诉你:

AI 已经被视为一种像写作、数据分析一样的基础能力,而不是锦上添花的技能。它意味着, 大学第一次在制度层面承认,“不会用 AI”本身,已经是一种能力缺陷。

但更微妙的变化,

发生在精英名校内部

如果说普渡的做法是制度上的正面迎战,那么斯坦福的变化更像是一种不安中的试探。

2024 年秋季,一门名为The Modern Software Developer 的课程在斯坦福爆满。

这门课最引发争议的一点是:学生几乎不需要写代码。老师教的是如何用 Cursor、Claude 等工具完成复杂软件任务,包括需求拆解、系统设计、调试、测试、迭代。

很多 CS 学生一开始是恐慌的。

因为他们突然意识到:过去那些“我会写代码”的优势,正在被迅速压缩。

与此同时,斯坦福内部的一些研究数据也开始流出:22–25 岁的初级软件工程岗位数量,相比 2022 年峰值已经下降近 20%。

而生成式 AI 的渗透,恰恰发生在这个时间段。

在课堂之外,产业端的反馈更加残酷。

Anthropic 的 CEO 曾公开表示,其部分产品代码中,70%–90% 由 AI 生成。

招聘经理也越来越直白:“过去需要 10 个初级工程师,现在是 2 个资深工程师 + AI。”

斯坦福这门“不写代码的课”,本质上不是在取悦学生,而是在替他们提前适应一个事实:未来工程师的价值,不再是执行,而是判断、管理和责任承担。

这不是个别学校的“激进实验”

如果只有普渡和斯坦福,事情还可以被当作个案。但真正让人警惕的是:类似的调整正在大规模发生。

佛罗里达大学推出了 AI Across the Curriculum 计划,明确要求 16 个学院把 AI 素养融入各自课程体系。

不是统一模板,而是让每个专业思考:

“在你这个学科里,AI 会改变什么?风险在哪里?人还剩下什么判断权?”

俄亥俄州立大学启动 AI Fluency Initiative,把 AI 素养直接纳入本科通识教育,与学术诚信并列讨论。

它传递的信息很清楚:AI 不是作弊工具,而是一种需要被规范使用的认知工具。

纽约市立大学系统(CUNY)甚至专门设立了 AI Academic Hub,强调 AI 的社会责任、公平性和伦理问题,试图让学生理解:AI 不只是“提高效率”,它也在重塑权力结构。

Colby College 这样的 Liberal Arts 学校,明确提出:在一个 AI 会“编造事实”的时代,判断信息可信度、拆解论证逻辑的能力,比任何工具操作都重要。

这并不是在背叛博雅教育,而是在用 AI 逼迫博雅教育回到它最核心的位置。

那大学是不是正在“放弃知识本身”?

很多家长和学生的直觉反应是:

“那我交这么多学费,是来学怎么用工具的吗?”

但如果把这些案例放在一起看,会发现一个被频繁误解的事实:大学并没有减少对知识的要求,反而在提高门槛。

区别在于,知识不再被视为“答案库”,而是被当作判断 AI 输出的参照系。

不会统计学的人,

很难判断模型结果是否站得住脚;

不理解历史语境的人,

无法分辨生成文本的价值立场;

没有理论训练的人,

根本无法意识到 AI 给出的方案里隐含了哪些假设。

这也是为什么,真正推动 AI 教育改革的高校,几乎都在强调一个词:critical use,而不是 mere usage。

所以,学生到底应该学什么?

答案可能并不浪漫,但非常现实。

未来的竞争,不在于谁“会不会用 AI”,而在于谁:

- 能不能拆解问题,而不是直接问答案

- 能不能发现 AI 的漏洞,而不是照单全收

- 能不能在复杂情境中承担判断后果

大学正在用一种近乎残酷的方式告诉学生:工具会越来越强,但“替你负责”的人,永远只能是你自己。

AI 并没有让大学教育失效。

它只是让“混过去”的空间,急剧缩小了。

当高校开始把 AI 能力写进毕业要求、课堂结构和通识体系时,它们其实在做一件很冒险的事:承认自己无法再用“知识垄断”来定义价值。

但或许,这正是大学教育真正需要面对的时刻。

不是问“AI 会不会取代你”,而是问:当答案唾手可得,你是否还知道该问什么问题。